8 συμβουλές για τον εντοπισμό εικόνων τεχνητής νοημοσύνης

- Αυτό το άρθρο δημοσιεύθηκε πριν από τουλάχιστον ένα έτος.

- Δημοσιεύθηκε στις 17 Ιανουαρίου 2025 στις 10:55

- 8 λεπτά ανάγνωσης

- Του/Της: AFP Γαλλία

- Μετάφραση και προσαρμογή Magdalini GKOGKOU, AFP Ελλάδα

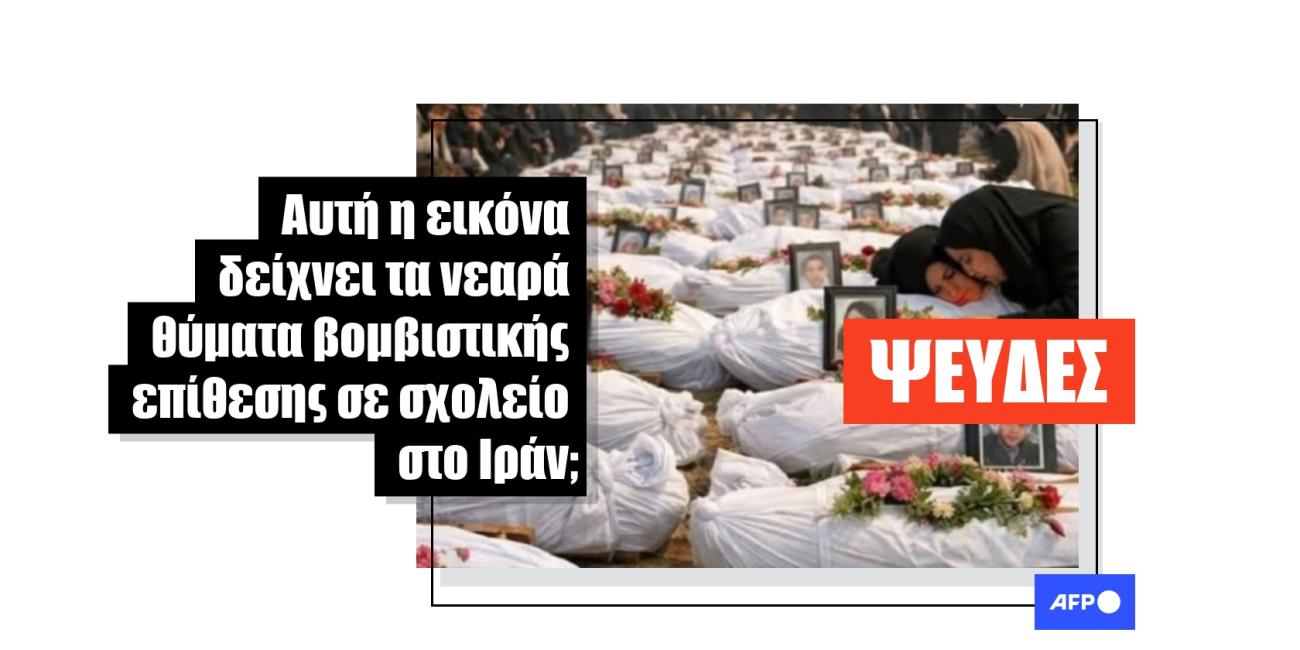

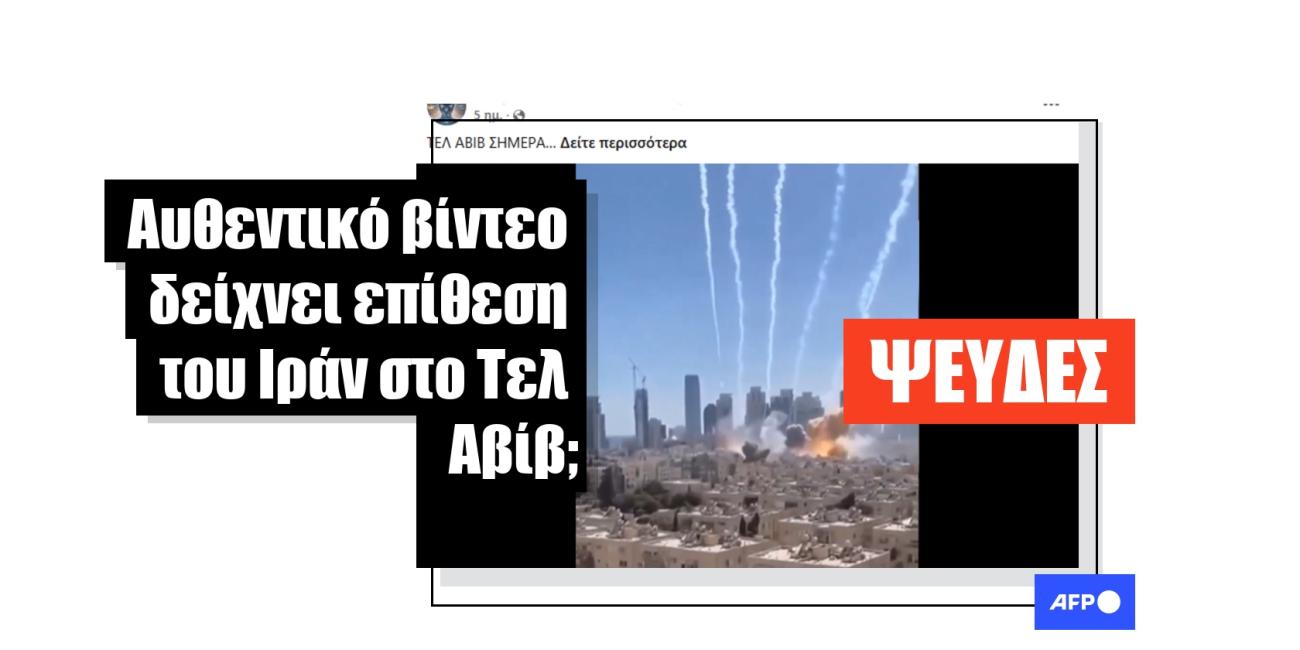

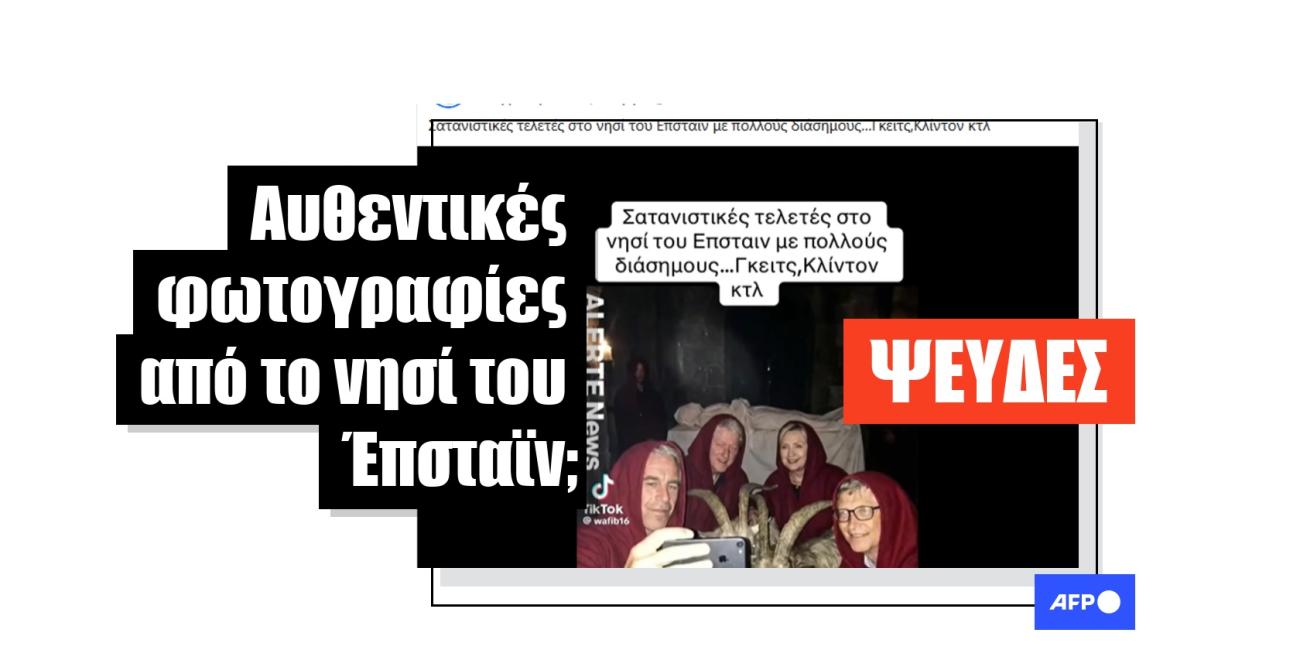

Φωτογραφία, βίντεο, ήχος: όποια και αν είναι η μορφή του, το περιεχόμενο που παράγεται από την τεχνητή νοημοσύνη (ΤΝ) κυκλοφορεί πλέον σε μεγάλο βαθμό στα κοινωνικά δίκτυα, χάρη στην ανάπτυξη εργαλείων δημιουργίας προσβάσιμων στο ευρύ κοινό, όπως τα MidJourney, DALL-E, Imagen και Synthesia.

Αυτό το αυξανόμενο κύμα πλαστών δημοσιεύσεων μπορεί να χρησιμοποιηθεί τόσο για ψυχαγωγία όσο και για παραπληροφόρηση - ειδικά όταν αυτές εκτρέπονται από τον αρχικό τους σκοπό και χρησιμοποιούνται εκτός πλαισίου.

Προς το παρόν δεν υπάρχει ένα 100% αξιόπιστο εργαλείο για τον εντοπισμό ψευδούς περιεχομένου, αλλά το AFP προσφέρει οκτώ συμβουλές που μπορούν να βοηθήσουν στον εντοπισμό δημιουργιών που παράγονται από τεχνητή νοημοσύνη.

1. Αναζητήστε τις λέξεις «Δημιουργημένο με ΤΝ»

«Κατασκευασμένο με τεχνητή νοημοσύνη», «περιεχόμενο που παράγεται από τεχνητή νοημοσύνη» ή «κατασκευασμένο με AI»: αυτές οι αναφορές, που υπάρχουν σε ορισμένες από τις δημοσιεύσεις που κοινοποιούνται στα κοινωνικά δίκτυα, μπορούν να αποτελέσουν ένα πρώτο στοιχείο για την αναγνώριση.

Ορισμένες πλατφόρμες, όπως το Instagram και το TikTok, προσθέτουν αυτή την ετικέτα αυτόματα μόλις εντοπίσουν περιεχόμενο που παράγεται ή τροποποιείται από τεχνητή νοημοσύνη (αρχειοθετημένοι σύνδεσμοι εδώ και εδώ).

Οι δημιουργοί αυτών των αναρτήσεων μπορούν επίσης να εισάγουν οι ίδιοι αυτές τις πληροφορίες όταν δημοσιεύουν περιεχόμενο στο διαδίκτυο.

Αλλά προσοχή: δεν χαρακτηρίζονται συστηματικά όλες οι τεχνητά δημιουργημένες εικόνες ως τέτοιες. Και, αντίστροφα, είναι δυνατόν μια εικόνα να αναγνωριστεί ως δημιουργημένη από τεχνητή νοημοσύνη, ενώ αυτό δεν ισχύει.

2. Εξετάστε την πηγή του περιεχομένου

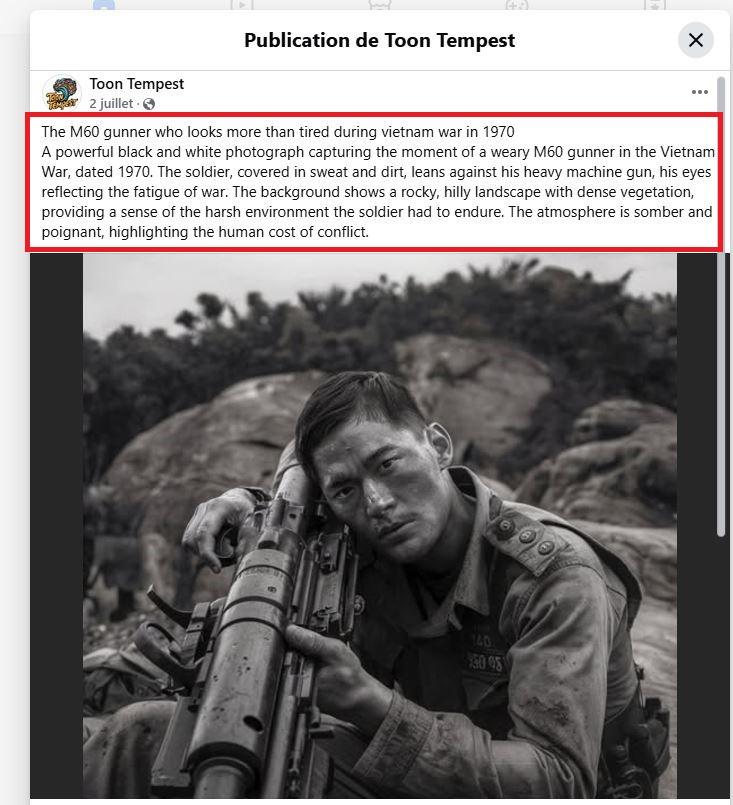

Ένας εξαντλημένος στρατιώτης, που στηρίζεται στο όπλο του κάνοντας μια σύντομη στάση στη μέση του πολέμου του Βιετνάμ: αυτή η εικόνα που κοινοποιήθηκε στο Facebook, όσο ρεαλιστική και αν είναι, είναι έργο της τεχνητής νοημοσύνης.

Αυτό μπορεί να γίνει αντιληπτό με διάφορους τρόπους, ξεκινώντας από τη λεζάντα που συνοδεύει την εικόνα - η οποία δεν είναι άλλη από την κειμενική οδηγία («prompt» στα αγγλικά) που στάλθηκε στην τεχνητή νοημοσύνη για τη δημιουργία αυτού του σκηνικού.

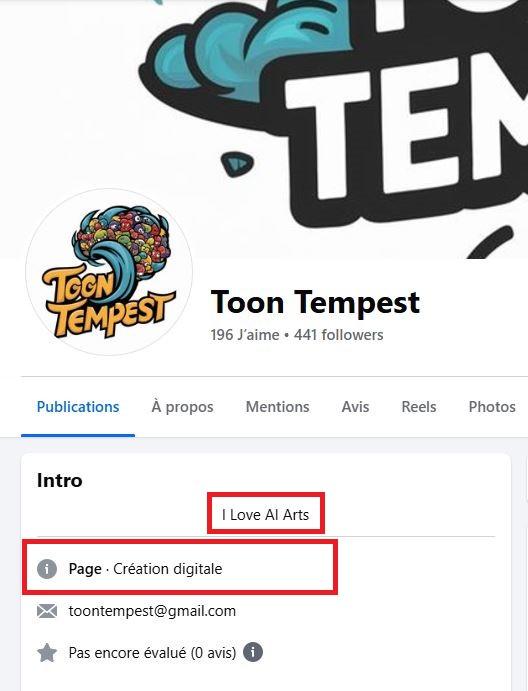

Επιπλέον, μπορείτε να δείτε στη σελίδα του χρήστη στο Facebook πως λέει ότι «αγαπάει την τέχνη της τεχνητής νοημοσύνης» και ειδικεύεται στην «ψηφιακή δημιουργία». Αυτό φαίνεται και σε άλλες δημοσιεύσεις του, οι οποίες περιλαμβάνουν τις «κειμενικές οδηγίες» πίσω από κάθε εικόνα.

3. Ελέγξτε τις προηγμένες «πληροφορίες»

Η λεζάντα σε αυτό το βίντεο που κοινοποιήθηκε τον Σεπτέμβριο του 2023 υποστηρίζει ότι ο Εμανουέλ Μακρόν θα ανακοίνωνε «την παραίτησή του».

Ο μόνος που μίλησε σε αυτό το βίντεο, ο αρχηγός του κράτους, εξήγησε, με μια φωνή που ακουγόταν σαν τη δική του, ότι η «μη ικανοποίηση» και η «δυσαρέσκεια» του γαλλικού λαού με τη «διακυβέρνησή» του, που εκφράστηκε κυρίως με τα σφυρίγματα στην τελετή έναρξης του Παγκοσμίου Κυπέλλου Ράγκμπι 2023 στη Γαλλία, τον οδήγησαν να λάβει «τη δύσκολη αλλά αναγκαία απόφαση να παραιτηθεί από τα καθήκοντά του ως Προέδρου της Δημοκρατίας».

Αναμφίβολα, τα μέσα μαζικής ενημέρωσης θα είχαν καλύψει ένα τέτοιο σημαντικό γεγονός.

Μια απλή αναζήτηση με λέξεις-κλειδιά για το θέμα αποκαλύπτει ότι ποτέ δεν έγινε καμία τέτοια ανακοίνωση. Διάφορες επιγραφές στις εικόνες (όπως «30 Ιουνίου 2023» και «Le Parisien») αποκαλύπτουν επίσης το αρχικό βίντεο στο οποίο προστέθηκε ο ψεύτικος ήχος.

Όπως εξηγήσαμε σε ένα άρθρο του Σεπτεμβρίου του 2023, πρόκειται για ένα βίντεο της ημερήσιας γαλλικής εφημερίδας που αναρτήθηκε στο διαδίκτυο το απόγευμα της 30ής Ιουνίου 2023.

Βιντεοσκοπήθηκε κατά τη διάρκεια συνεδρίασης της διυπουργικής μονάδας αντιμετώπισης κρίσεων -το λογότυπο της οποίας διακρίνεται πίσω από τον Πρόεδρο- που συστάθηκε για να αντιμετωπίσει τις ταραχές μετά το θάνατο του νεαρού Nahel Merzouk, ο οποίος σκοτώθηκε κατά τη διάρκεια αστυνομικού ελέγχου στο προάστιο Ναντέρ του Παρισιού στις 27 Ιουνίου 2024.

Σε αυτό, ο Εμανουέλ Μακρόν «καταδίκασε» την αστική βία και ανακοίνωσε ότι θα ενισχυθούν οι αστυνομικές δυνάμεις για να τεθεί τέλος σε αυτή. Δεν είχε καμία σχέση, επομένως, με μια πιθανή παραίτηση.

4. Εικόνες που είναι υπερβολικά «τέλειες»

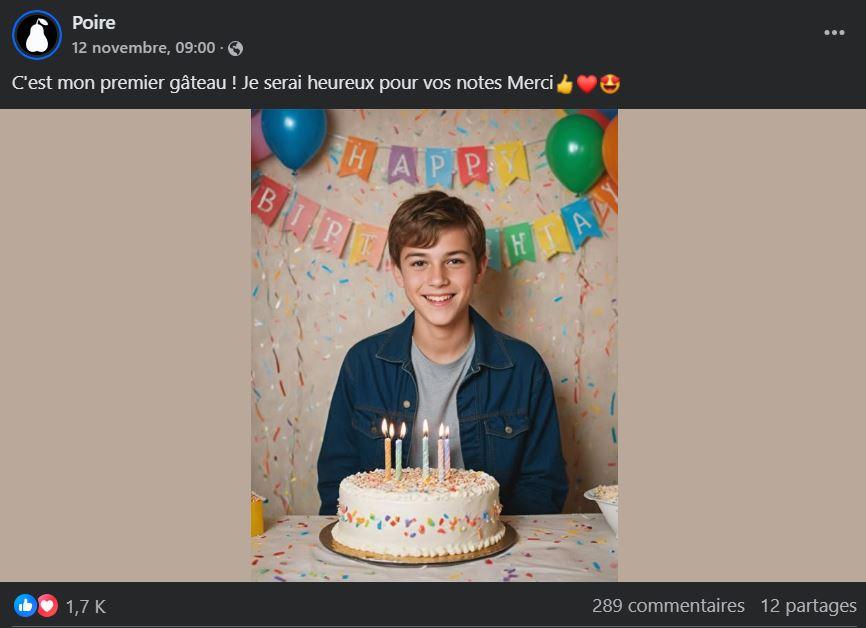

Ένα μωρό που παίζει κιθάρα, ένα παιδί που γιορτάζει τα γενέθλιά του ή ηλικιωμένοι που μαζεύουν περήφανα πατάτες: αυτές οι φωτογραφίες που κοινοποιούνται στο Facebook φαίνονται τέλειες από αισθητική άποψη και δημιουργούν πολλά ενθουσιώδη σχόλια στην πλατφόρμα.

Αλλά μια πιο προσεκτική εξέταση μάς επιτρέπει να καταλάβουμε ότι το δέρμα και τα μαλλιά αυτών των ανθρώπων φαίνονται πολύ απαλά και αφύσικα.

Κάθε μία από αυτές τις εικόνες έχει επίσης μια σειρά από μικρές ατέλειες που προδίδουν τη χρήση τεχνητής νοημοσύνης: το μωρό έχει μόνο τέσσερα δάχτυλα και στο πανό γενεθλίων οι λέξεις «Happy Birthday» («Χρόνια πολλά») είναι γραμμένες λάθος.

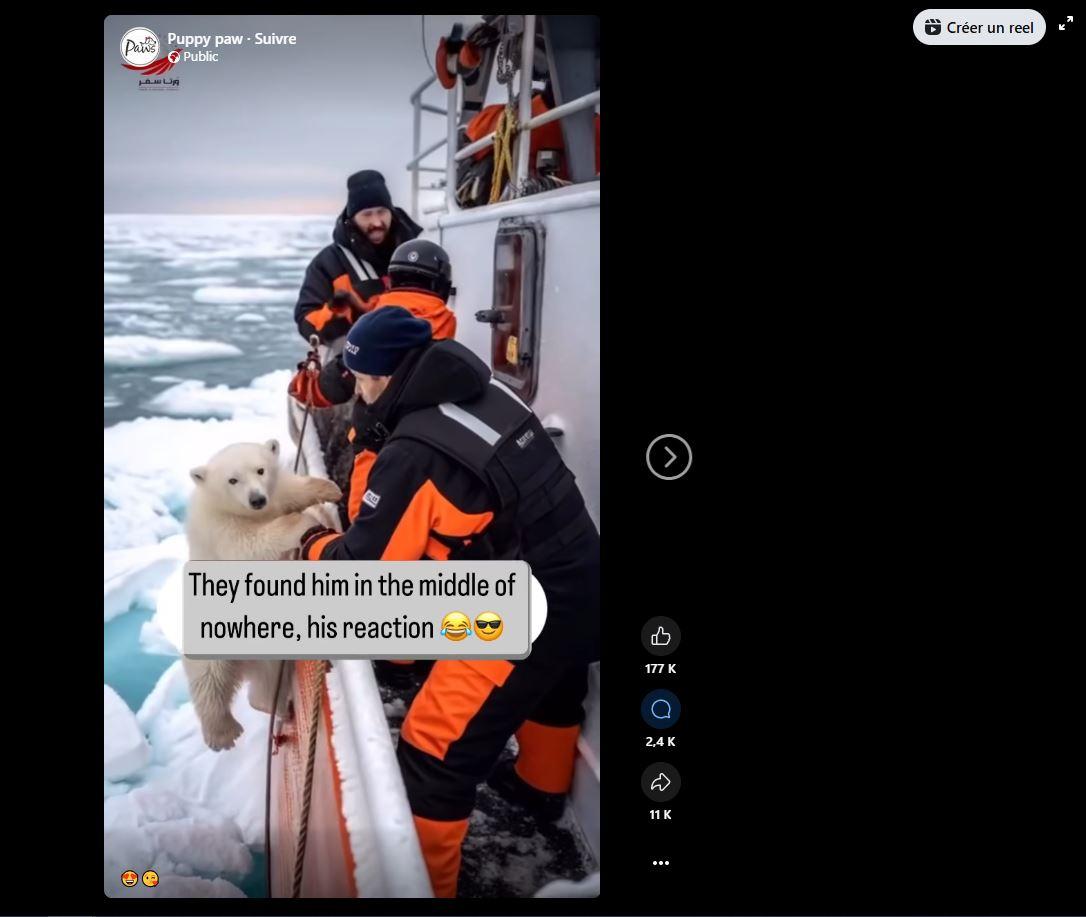

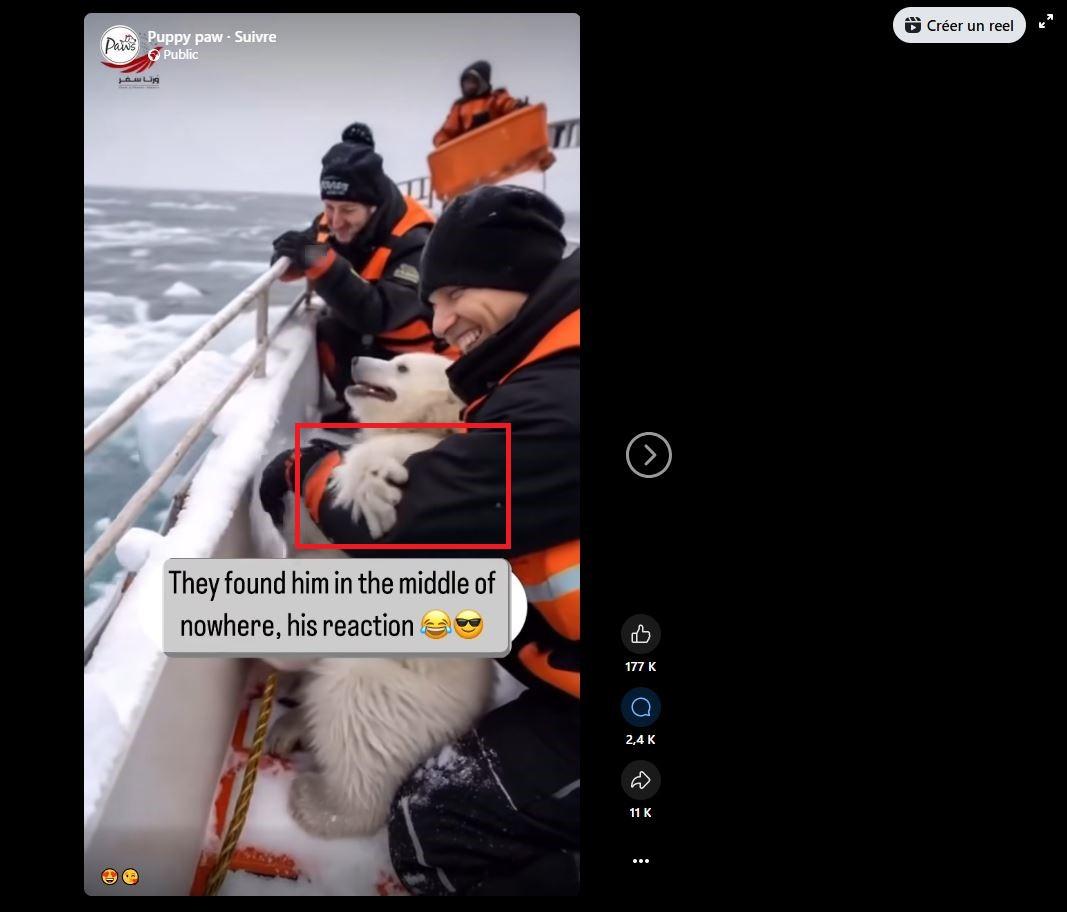

Το ίδιο ισχύει και για αυτό το viral βίντεο που υποτίθεται ότι δείχνει ναυτικούς να μοιράζονται μια τρυφερή αγκαλιά με ένα μικρό πολικό αρκουδάκι που συνάντησαν κατά τη διάρκεια του ταξιδιού τους.

Η ιστορία και οι πολύ συγκινητικές εικόνες πυροδοτούν τα συναισθήματα των χρηστών του διαδικτύου.

Αλλά κάνουν λάθος, όπως μπορείτε να διαπιστώσετε από την υπερβολικά «τέλεια» εμφάνιση της μικρής αρκούδας, και από ορισμένες λεπτομέρειες, όπως τα πόδια της, τα οποία ανά σημεία αποκτούν ανθρώπινη μορφή.

5. Παρατηρήστε το φόντο των εικόνων

Ένα φουσκωτό μπαλόνι με το ομοίωμα του Ντόναλντ Τραμπ κατά τη διάρκεια της περίφημης παρέλασης της Ημέρας των Ευχαριστιών στη Νέα Υόρκη;

Μια πιο προσεκτική ματιά στο φόντο αυτής της εικόνας που κυκλοφόρησε στα κοινωνικά δίκτυα αποκαλύπτει μια σειρά από ενδείξεις ότι πρόκειται για δημιουργία τεχνητής νοημοσύνης.

Τα πρόσωπα διαφόρων περαστικών στο πλήθος είναι ελλιπή ή παραμορφωμένα.

Επίσης, το μπαλόνι που δείχνει τον Ντόναλντ Τραμπ κρατιέται με μη ρεαλιστικό τρόπο από λίγους ανθρώπους, οι οποίοι με δυσκολία φαίνονται ικανοί να κρατήσουν ένα τόσο επιβλητικό σχήμα στον αέρα έχοντας μια τόσο πρόχειρη εγκατάσταση.

6. Δώστε προσοχή στις ιστορικές ασυνέπειες

«Εγκαίνια του Πύργου του Άιφελ, 1889», γράφει η λεζάντα σε μια ασπρόμαυρη φωτογραφία που κοινοποιήθηκε στο Facebook.

Μόνο που δείχνει αρκετούς ανθρώπους στο πλήθος να φωτογραφίζουν το διάσημο κτίριο με... smartphones. Μερικές φορές η κοινή λογική είναι το μόνο που χρειάζεται για να εντοπίσεις μια εικόνα που έχει δημιουργηθεί από τεχνητή νοημοσύνη.

7. Βρείτε τη μετάφραση

Ο Εμανουέλ Μακρόν μιλάει στα αραβικά; Αυτό φαίνεται να δείχνει αυτό το βίντεο που κοινοποίησαν αρκετοί διαδικτυακοί χρήστες, με τον ισχυρισμό ότι ο Γάλλος Πρόεδρος ανακοίνωσε τη διδασκαλία της γλώσσας αυτής «από το νηπιαγωγείο».

Ωστόσο, πρόκειται για deepfake (περιεχόμενο ήχου ή βίντεο που τροποποιείται με τη χρήση τεχνητής νοημοσύνης για να κάνει κάποιον να πει κάτι που δεν έχει πει).

Αν ακούσετε προσεκτικά αυτό το βίντεο, μπορείτε να καταλάβετε ότι έχει δημιουργηθεί από τεχνητή νοημοσύνη. Η σιωπή στο παρασκήνιο καθώς ο αρχηγός του κράτους μιλάει στην ύπαιθρο μπροστά σε ένα ακροατήριο είναι ένα σημαντικό στοιχείο, όπως και η ελαφρώς ρομποτική αναπνοή του.

Μπορείτε ακόμη να παρατηρήσετε ότι η κίνηση των χειλιών του είναι ανά σημεία αφύσικη και κακώς συγχρονισμένη με τα λόγια του.

8. Χρήση αντίστροφης αναζήτησης εικόνας

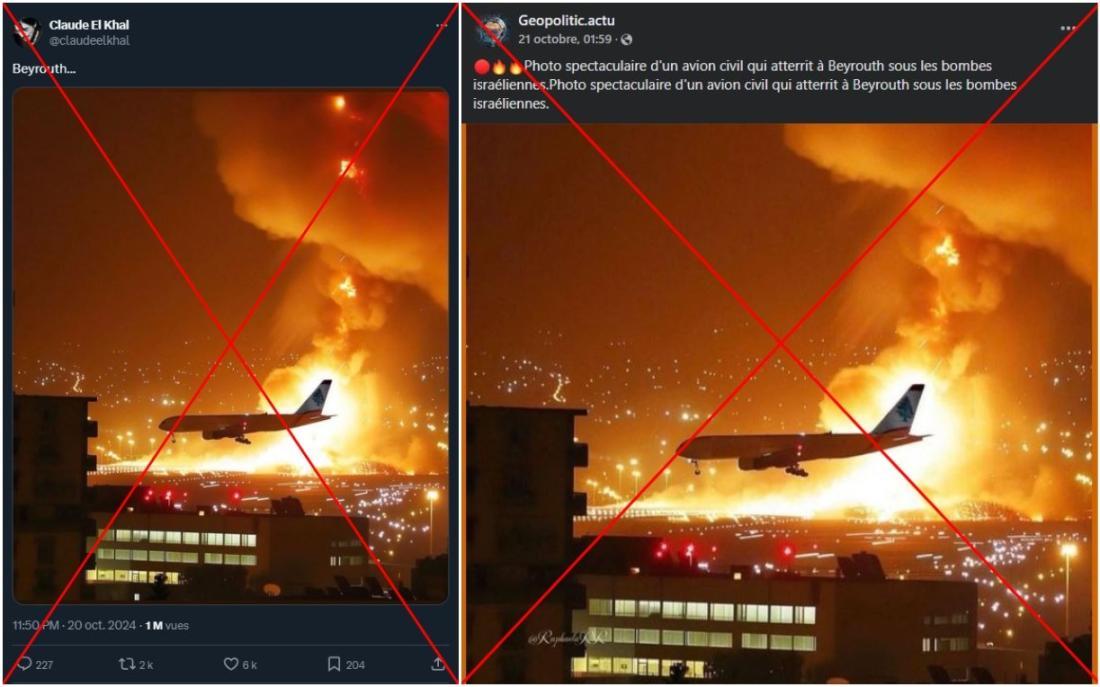

Αυτή η εικόνα ενός αεροπλάνου που πετάει κοντά στο σημείο μιας μαζικής έκρηξης στο αεροδρόμιο της Βηρυτού, στον Λίβανο, προκάλεσε πολυάριθμες αναπαραγωγές και αντιδράσεις το φθινόπωρο του 2024, στο πλαίσιο μιας σειράς χτυπημάτων του ισραηλινού στρατού στην πρωτεύουσα του Λιβάνου στις 20 Οκτωβρίου 2024 με στόχο χρηματοπιστωτικά ιδρύματα που συνδέονταν με τη Χεζμπολάχ.

Μια αντίστροφη αναζήτηση εικόνας σε συνδυασμό με μια σύνθετη αναζήτηση στο διαδίκτυο εντοπίζει την εικόνα σε διάφορους λογαριασμούς Instagram που αναφέρουν ότι υποτίθεται πως «δημιουργήθηκε από ΤΝ» (αρχειοθετημένοι σύνδεσμοι εδώ και εδώ).

Η αντίστροφη αναζήτηση εικόνας έχει επίσης το πλεονέκτημα της ανάδειξης παρόμοιων λήψεων, όπως εξήγησε το AFP σε άρθρο του τον Μάρτιο του 2023. Αυτό μπορεί να είναι πολύ σημαντικό για τη σύγκριση μιας φωτογραφίας για την οποία υπάρχει υποψία ότι δημιουργήθηκε από τεχνητή νοημοσύνη με λήψεις από αξιόπιστες πηγές.

Στο πλαίσιο της πολυδιαφημισμένης συνάντησης μεταξύ του Βλαντιμίρ Πούτιν και του Σι Τζινπίνγκ, κυκλοφόρησε εκείνη την εποχή στα κοινωνικά δίκτυα μια φωτογραφία χωρίς πηγή που έδειχνε τον Ρώσο πρόεδρο να γονατίζει μπροστά στον Κινέζο ηγέτη.

Ωστόσο, όπως επισήμανε ο Ιταλός δημοσιογράφος Ντέιβιντ Πουέντε, το σκηνικό σε αυτή την εικόνα ήταν πολύ διαφορετικό από αυτό που εμφανίζεται σε άλλες εικόνες μέσων ενημέρωσης που κάλυπταν το γεγονός, εγείροντας αμφιβολίες σχετικά με τη γνησιότητα του viral στιγμιότυπου.

Πνευματικά δικαιώματα © AFP 2017-2026. Οποιαδήποτε εμπορική χρήση αυτού του περιεχομένου απαιτεί συνδρομή. Κάντε κλικ εδώ για να μάθετε περισσότερα.

Υπάρχει περιεχόμενο που θα θέλατε να ελέγξει το AFP;

Επικοινωνήστε μαζί μας