Εικόνες AI που δείχνουν ανθρώπους με πολύ μακρύ λαιμό κοινοποιούνται στο διαδίκτυο ως αληθινές

- Αυτό το άρθρο δημοσιεύθηκε πριν από τουλάχιστον ένα έτος.

- Δημοσιεύθηκε στις 17 Φεβρουάριος 2025 στις 13:32

- Επικαιροποιήθηκε 18 Φεβρουάριος 2025 στις 10:02

- 4 λεπτά ανάγνωσης

- Του/Της: Pasika KHERNAMNUOY, AFP Ταϊλάνδη

- Μετάφραση και προσαρμογή Magdalini GKOGKOU, AFP Ελλάδα

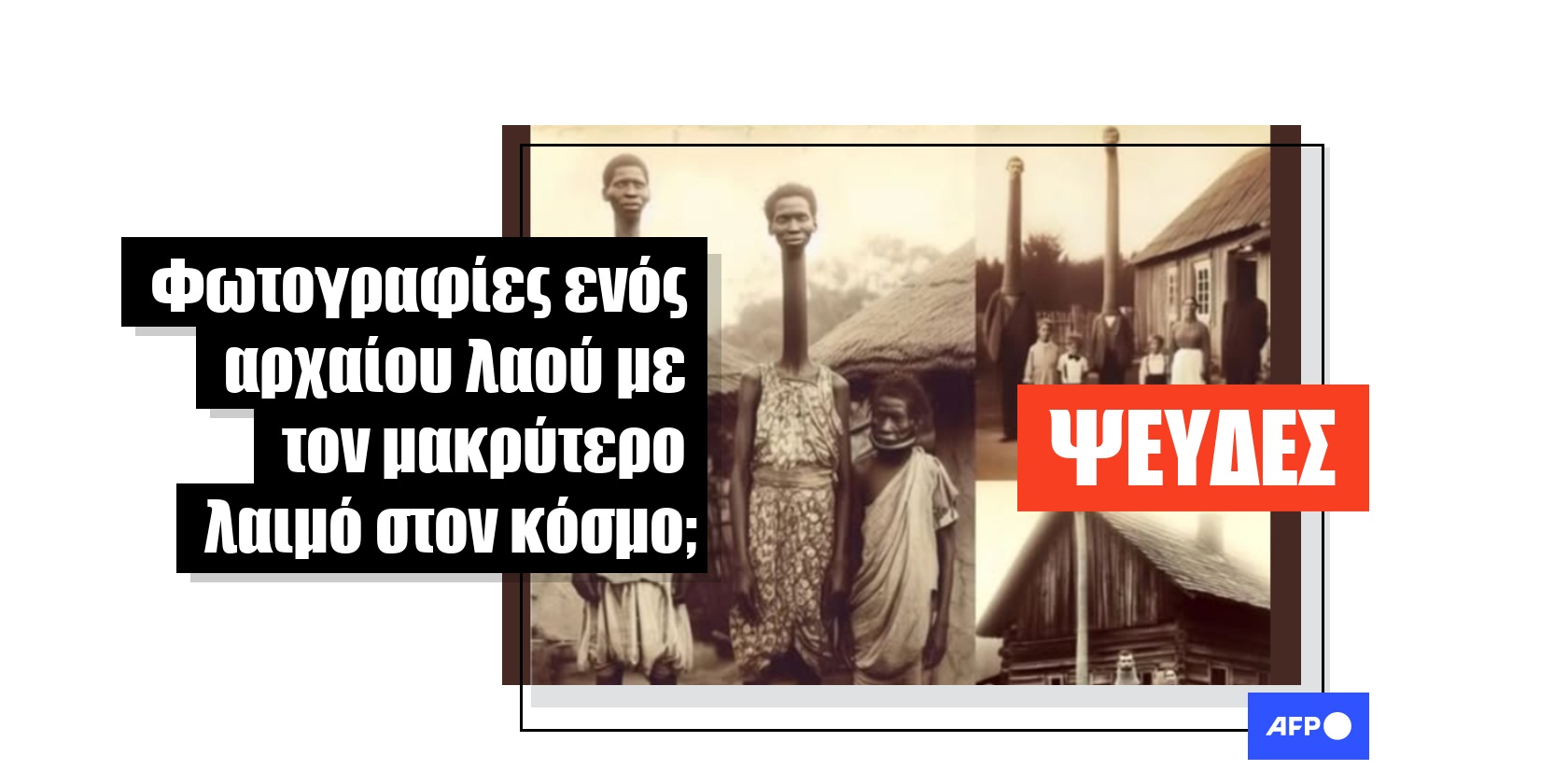

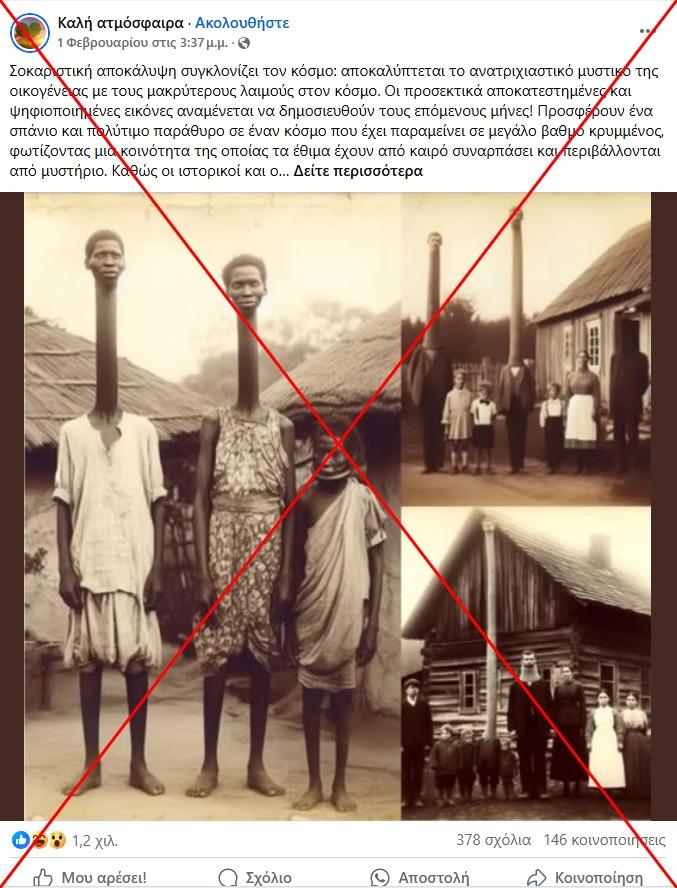

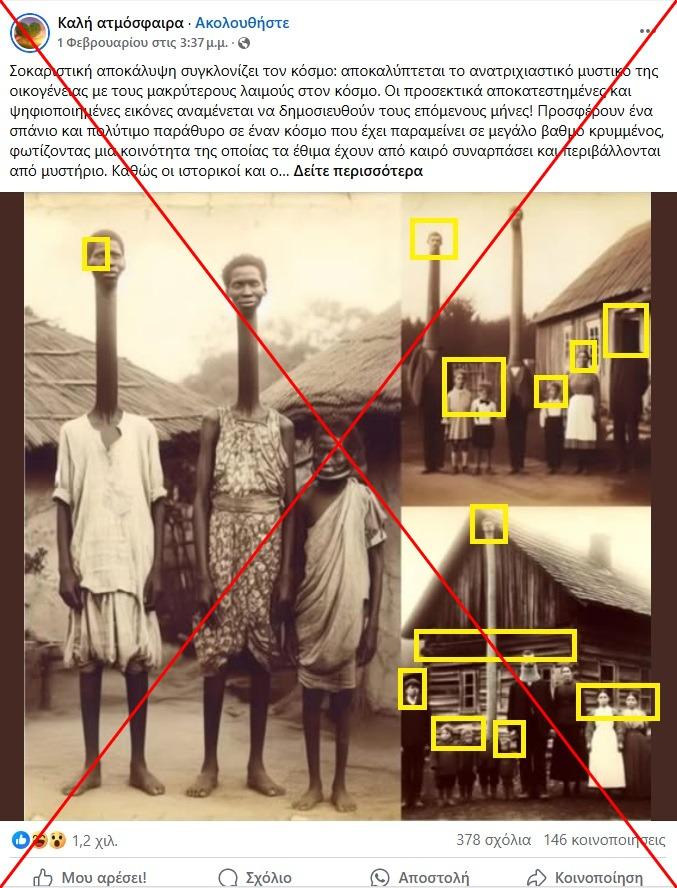

«Σοκαριστική αποκάλυψη συγκλονίζει τον κόσμο: αποκαλύπτεται το ανατριχιαστικό μυστικό της οικογένειας με τους μακρύτερους λαιμούς στον κόσμο», αναφέρει μια ανάρτηση στο Facebook από την 1 Φεβρουαρίου 2025, η οποία περιλαμβάνει ένα κολάζ τριών φωτογραφιών σε σέπια, οι οποίες δείχνουν ανθρώπους με λαιμό τουλάχιστον όσο ένα χέρι.

«[...] αυτή η εξαιρετική ανακάλυψη ελπίζεται ότι θα οδηγήσει σε μια βαθύτερη κατανόηση και εκτίμηση του λαού των Καγιάν και της αξιοθαύμαστης πολιτιστικής τους κληρονομιάς», συνεχίζει ο χρήστης στην ανάρτηση.

Ο ίδιος ισχυρισμός με την ίδια εικόνα κοινοποιήθηκε και από άλλους χρήστες στο Facebook (εδώ, εδώ και εδώ) και από ελληνικούς ιστότοπους (εδώ και εδώ).

Παρόλο που αρκετοί χρήστες έγραφαν χιουμοριστικά σχόλια κάτω από τις αναρτήσεις, αρκετοί σχολίαζαν με τρόπο που φανερώνει ότι πίστευαν πως οι εικόνες ήταν αληθινές. «Που ζούμε ποτε αυτή η ανθρωπότητα θα αποκτήσει νοημοσύνη και δεν θα την σέρνουν από την μύτη αναχρονιστικοι άνθρωποι που ζουν στον μεσαιωνα» έγραψε ένας χρήστης. «Απίστευτο είναι ειναι αλήθεια όμως», σχολίασε ένας άλλος.

Παρόμοιοι ισχυρισμοί μαζί με τις ίδιες ή παρόμοιες φωτογραφίες έχουν κοινοποιηθεί από το 2024 και σε άλλες γλώσσες, μεταξύ άλλων στα γαλλικά, τα αραβικά, τα αγγλικά, τα χίντι, τα ιαπωνικά, τα σουαχίλι και τα ταϊλανδέζικα.

Ωστόσο, οι εικόνες έχουν δημιουργηθεί με τεχνητή νοημοσύνη και δεν έχουν καμία σχέση με οποιαδήποτε ανακάλυψη, ούτε με την ύπαρξη ενός αρχαίου λαού με αφύσικα μεγάλους λαιμούς.

Εικόνες από έναν λογαριασμό με περιεχόμενο δημιουργημένο από AI

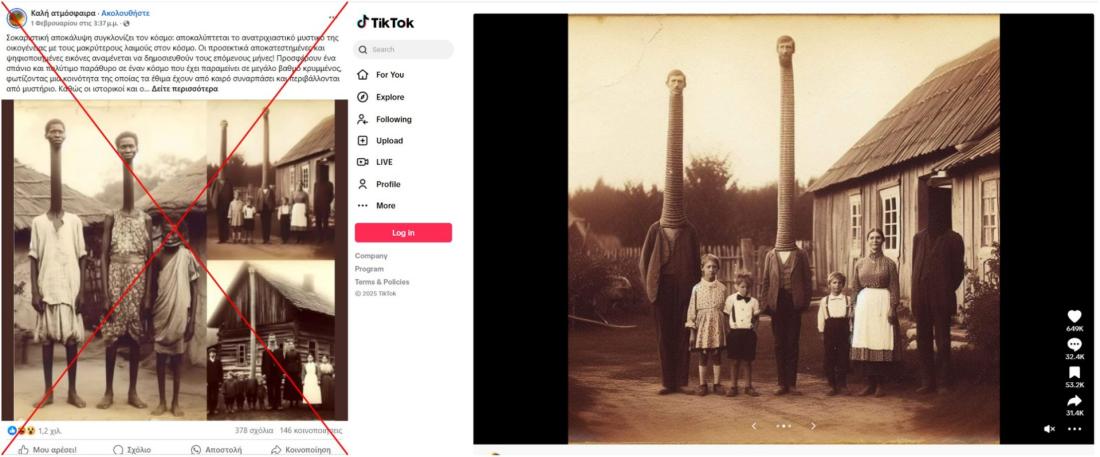

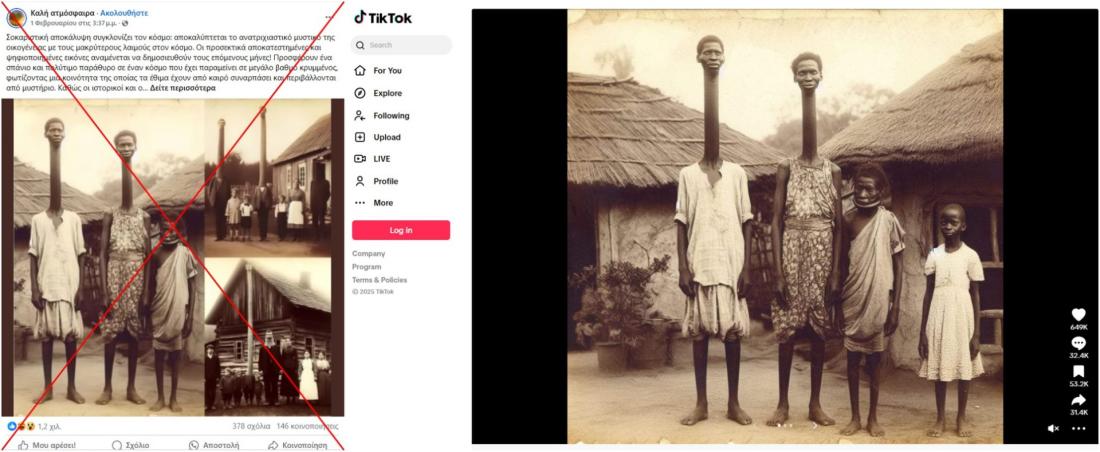

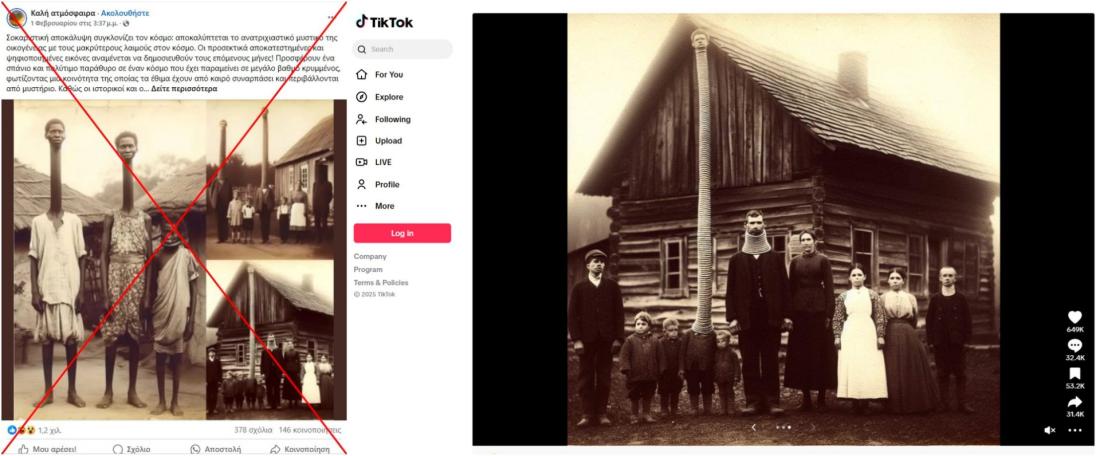

Οι τρεις πιο συχνές εικόνες που εμφανίζονται στα κοινωνικά δίκτυα δείχνουν ενήλικες με ασυνήθιστα μακρύ λαιμό να στέκονται δίπλα σε παιδιά.

Οι αντίστροφες αναζητήσεις εικόνων σε συνδυασμό με αναζητήσεις λέξεων-κλειδιών μάς οδήγησαν σε πολυάριθμες δημοσιεύσεις που σχετίζονται με αυτές τις τρεις viral εικόνες, η παλαιότερη από τις οποίες εντοπίζεται σε ένα βίντεο που δημοσιεύτηκε στο TikTok στις 23 Νοεμβρίου 2023 (σύνδεσμος αρχειοθετημένος εδώ).

Παρακάτω μπορείτε να δείτε μια σύγκριση στιγμιότυπων οθόνης των εικόνων που εμφανίζονται σε μία από τις viral δημοσιεύσεις στο Facebook (αριστερά) και στο αρχικό βίντεο του TikTok (δεξιά).

Η λεζάντα του βίντεο αναφέρει ότι οι ιστορικές αυτές εικόνες, οι οποίες λέγεται ότι διέρρευσαν πρόσφατα, χρονολογούνται από το 1860 και δείχνουν τους «3 υποψηφίους» σε έναν «διαγωνισμό για την εύρεση της οικογένειας με τον μακρύτερο λαιμό».

Αλλά προσέξτε! Ο λογαριασμός πίσω από το βίντεο ονομάζεται «FunnyAIpics» και το προφίλ του αναφέρει ότι δημιουργεί «παράξενη και αστεία τέχνη που παράγεται από τεχνητή νοημοσύνη» (αρχειοθετημένος σύνδεσμος εδώ).

Οι εικόνες αυτές δημιουργήθηκαν από την αρχή με τεχνητή νοημοσύνη για ψυχαγωγικούς σκοπούς, πριν υιοθετηθούν σοβαρά από άλλους λογαριασμούς.

Σαφή σημάδια δημιουργίας τεχνητής νοημοσύνης

Χωρίς να έχει ξανασυναντήσει το αρχικό βίντεο, ένας προσεκτικός χρήστης του διαδικτύου θα μπορούσε να είχε διαπιστώσει από μόνος του ότι αυτά τα πλάνα δημιουργήθηκαν από το μηδέν, επειδή οι εικόνες αυτές περιέχουν οπτικές ασυνέπειες που είναι χαρακτηριστικές στη δημιουργία τεχνητής νοημοσύνης, επισημαίνει ο Σου Χου, επικεφαλής του εργαστηρίου Μηχανικής Μάθησης και Εγκληματολογίας Μέσων Ενημέρωσης στο Πανεπιστήμιο Purdue των Ηνωμένων Πολιτειών.

Τονίζει την παρουσία παραμορφωμένων προσώπων, την απουσία κόρης στο μάτι ενός άνδρα, τους παραμορφωμένους τοίχους της ξύλινης καλύβας και ένα κεφάλι που λείπει από το σώμα ενός ενήλικα.

Σε παλαιότερα άρθρα (εδώ και εδώ) έχουμε εξηγήσει πώς μπορείτε να αναγνωρίζετε σημάδια εικόνων που έχουν δημιουργηθεί με τεχνητή νοημοσύνη.

Στην πραγματικότητα, υπάρχουν γυναίκες Παντάουνγκ στην πολιτεία Σαν (βορειοανατολική Βιρμανία) - γνωστές επίσης ως γυναίκες Καγιάν ή «γυναίκες με μακρύ λαιμό» - που χρησιμοποιούν αυτή την τεχνική για να επιμηκύνουν το λαιμό τους.

Από το 2018, έχουν καταγραφεί από τον ιστότοπο των Παγκόσμιων Ρεκόρ Γκίνες (αρχειοθετημένος σύνδεσμος εδώ) ως οι γυναίκες με τους μακρύτερους ανθρώπινους λαιμούς που έχουν καταγραφεί ποτέ, φτάνοντας τα 19,7 εκατοστά σε μήκος χάρη σε τυλιγμένους ορειχάλκινους δακτυλίους.

Στο παρελθόν το AFP έχει δημοσιεύσει ένα σχετικό ρεπορτάζ (αρχειοθετημένος σύνδεσμος εδώ).

«Αυτές οι εικόνες μπορούν εύκολα να οδηγήσουν στη διάδοση ψευδών πληροφοριών», προειδοποίησε ο ειδικός σε θέματα τεχνητής νοημοσύνης Σου Χου.

Το AFP έχει επαληθεύσει πολλές εικόνες που έχουν παραχθεί από τεχνητή νοημοσύνη, πολύ συχνά για σκοπούς χειραγώγησης, όπως εδώ, εδώ, εδώ και εδώ.

Πνευματικά δικαιώματα © AFP 2017-2026. Οποιαδήποτε εμπορική χρήση αυτού του περιεχομένου απαιτεί συνδρομή. Κάντε κλικ εδώ για να μάθετε περισσότερα.

Υπάρχει περιεχόμενο που θα θέλατε να ελέγξει το AFP;

Επικοινωνήστε μαζί μας